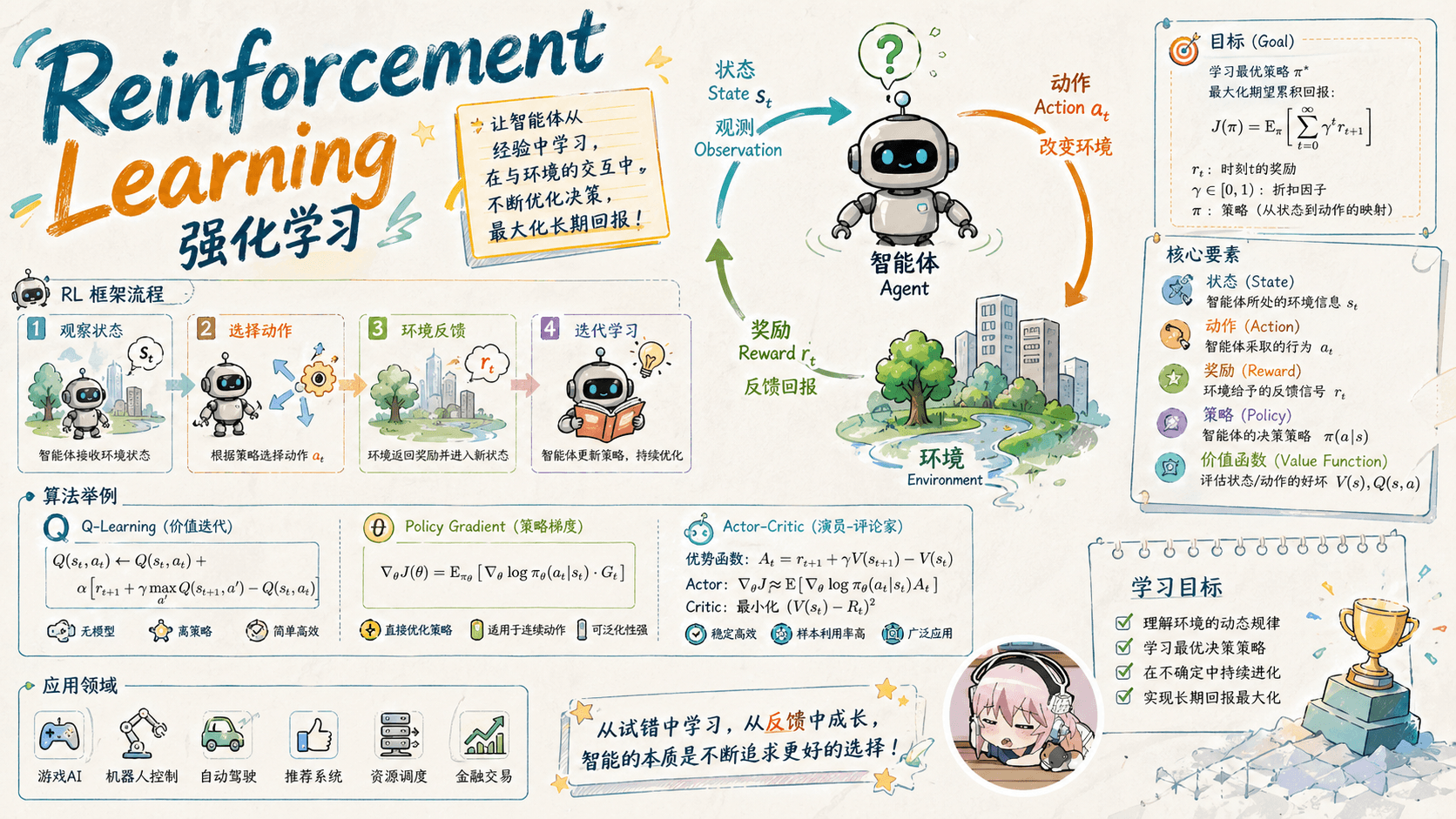

LLM Pre-training 预训练

基本概念

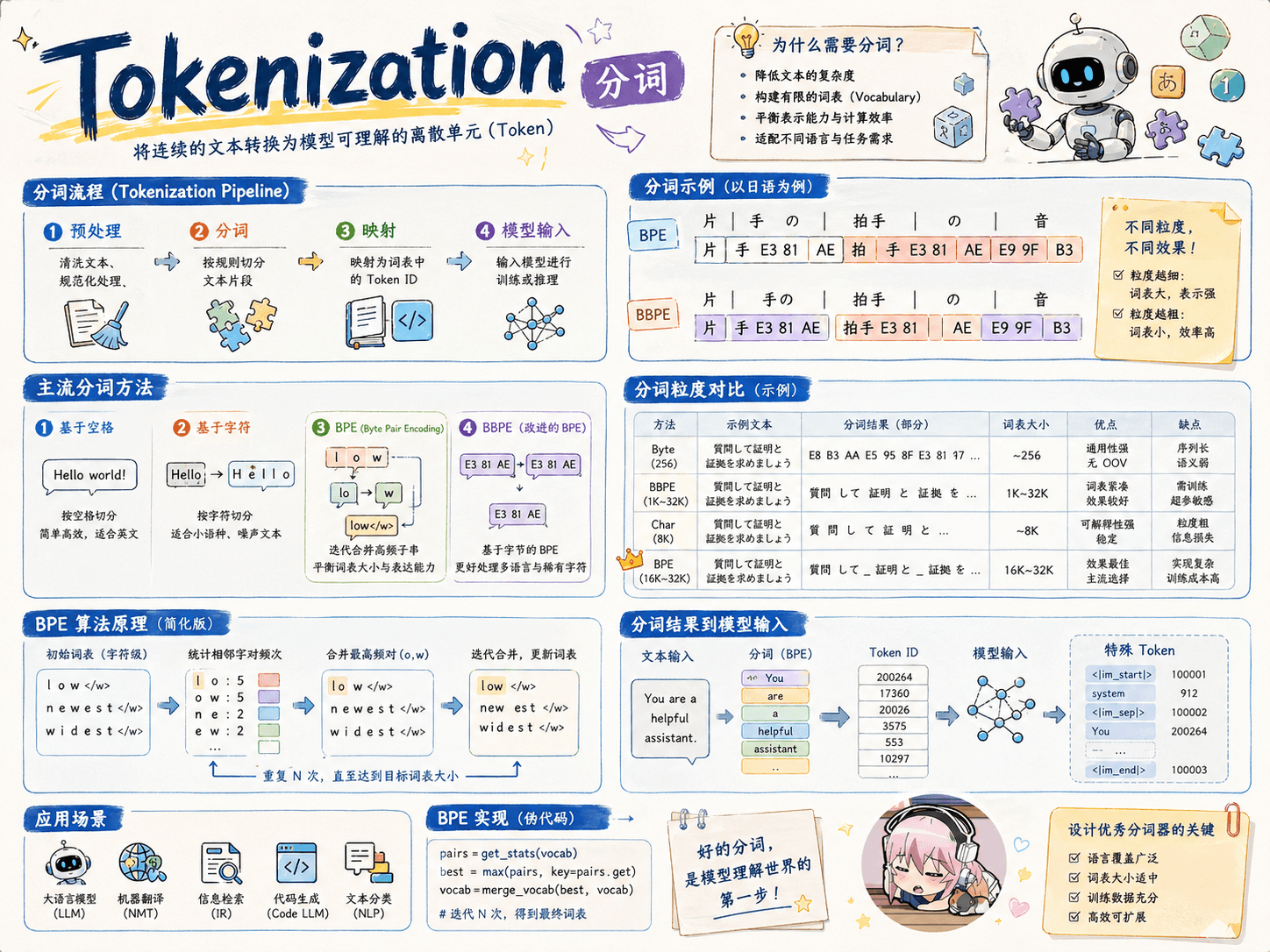

预训练:在大规模的通用数据集上对模型进行初步训练,在见到特定任务数据之前,使模型能够捕捉到数据的通用特征和模式,提升其在各种任务上的性能和泛化能力,同时减少对标注数据的依赖,生成一个具备基础能力的基座模型(base model) ,并加速模型在新任务上的训练和微调(fine-tuning)过程。在预训练期间,模型需要处理大量未标记的文本数据,例如书籍、文章和网站,目标是捕获文本语料库中存在的底层模式、结构和语义知识。

数据稀缺性:在现实世界的应用中,收集并标注大量数据往往是一项既耗时又昂贵的任务。特别是在某些专业领域,如医学图像识别或特定领域的文本分类,标记数据的获取更是困难重重。预训练技术使得模型能够从未标记的大规模数据中学习通用特征,从而****减少对标记数据的依赖,使得在有限的数据集上也能训练出性能良好的模型。

先验知识问题:在深度学习中,模型通常从随机初始化的参数开始学习。然而,对于许多任务来说,具备一些基本的先验知识或常识会更有帮助。预训练模型通过在大规模数据集上进行训练,学习到许多有用的先验知识,如语言的语法规则、视觉的底层特征等。这些先验知识为模型在新任务上的学习提供了有力的支撑。